La Inteligencia Artificial (IA) ha logrado avances increíbles en los últimos años. Sin embargo, comprender qué es una alucinación de IA y cómo superarla sigue siendo un proceso continuo para los creadores de LLM.

La tecnología de hoy y de mañana sigue fascinándonos a todos, especialmente cuando se trata de cómo la IA puede comprender y generar el lenguaje humano. Se han logrado grandes avances con los modelos de lenguaje grande (LLM), programas informáticos que se entrenan con grandes cantidades de texto. Estos LLM pueden escribir diferentes tipos de formatos de texto creativos, como poemas, códigos, guiones, piezas musicales, correos electrónicos, cartas, etc.

Sin embargo, existe un problema peculiar que surge con el poder de estos impresionantes modelos: a veces “alucinan”.

¿Qué es una alucinación de IA?

Así como los humanos pueden imaginar o soñar cosas que no son reales, la IA puede hacer algo similar. Las alucinaciones de IA ocurren cuando un LLM produce un texto que parece creíble pero que en los hechos es incorrecto. Estas alucinaciones pueden variar desde errores menores hasta historias completamente inventadas y declaraciones sin sentido.

Para comprender mejor este problema, veamos algunos ejemplos:

- Mezclando hechos: Una IA a la que se le pide que escriba un artículo de noticias sobre un evento puede incluir fechas y ubicaciones incorrectas, o tergiversar a las personas involucradas.

- Creando falso información: una IA encargada de escribir la descripción de un producto podría inventar características que el producto en realidad no tiene.

- Con seguridad incorrecto: Lo realmente complicado de las alucinaciones de la IA es que a menudo se presentan de una manera muy convincente, lo que dificulta distinguirlas de la información real.

¿Por qué las alucinaciones son un problema para los LLM?

Como puede ver en nuestras explicaciones sobre qué es una alucinación de IA, son un problema importante para los LLM por varias razones. Primero, si las personas no pueden confiar en el texto que genera un LLM, los usuarios pierden la fe en la utilidad y confiabilidad general de la tecnología. Imagine que está leyendo un resumen en línea de una noticia escrita por un LLM. Si el resumen contiene errores fácticos, es posible que dejes de utilizar esa fuente por completo. Esto puede ser un problema importante para cualquier aplicación que dependa de LLM para generar texto, como chatbots, asistentes virtuales o herramientas automatizadas de creación de contenido.

En segundo lugar, las alucinaciones de la IA podrían contribuir a la difusión de información errónea. En una época en la que las noticias falsas ya son una gran preocupación, el texto generado por IA que parece creíble podría fácilmente confundirse con información real. Esto podría tener un impacto negativo en todo, desde el discurso público hasta importantes procesos de toma de decisiones. Por ejemplo, imagine un LLM creando publicaciones en las redes sociales sobre un candidato político que contiene información falsa.

Estas publicaciones podrían engañar a los votantes e influir en el resultado de una elección. Esa es la razón exacta por la que Google ha desactivado la capacidad de Gemini para responder a consultas relacionadas con las elecciones.

En tercer lugar, las empresas u organizaciones que utilizan LLM podrían enfrentar daños a su reputación si sus sistemas de inteligencia artificial producen contenido inexacto o dañino. Digamos que una empresa utiliza un LLM para escribir descripciones de productos para su tienda en línea. Si el LLM inventa características que los productos en realidad no tienen, podría generar insatisfacción en el cliente y dañar la reputación de la empresa.

¿Por qué ocurren las alucinaciones por IA?

Tienes algunas ideas sobre qué es una alucinación de IA ahora, pero ¿por qué suceden? Varios factores contribuyen a este problema:

- como se entrenan: Los LLM reciben enormes cantidades de datos de texto. Estos datos suelen contener errores, sesgos e información desactualizada. La IA aprende de estos datos al igual que de la información correcta.

- Comprender versus crear: Los LLM son buenos para comprender patrones en el lenguaje, pero no siempre tienen una comprensión sólida de los conceptos o la lógica del mundo real. Pueden generar algo que parezca plausible sin que en realidad sea cierto.

- La búsqueda de la fluidez: Los LLM están diseñados para producir texto que suene natural y humano. A veces, esto significa “llenar los espacios en blanco” donde pueda haber lagunas en el conocimiento de la IA. Esos espacios en blanco pueden llevar a que la IA invente contenido.

¿Qué se está haciendo para solucionar esto?

Los investigadores y desarrolladores de la comunidad de IA están trabajando activamente en formas de reducir las alucinaciones de IA.

Algunos de los enfoques incluyen:

- Mejores datos de entrenamiento: Crear conjuntos de datos cuidadosamente seleccionados que tengan menos probabilidades de contener errores y sesgos, lo que conduce a un mejor comportamiento de la IA.

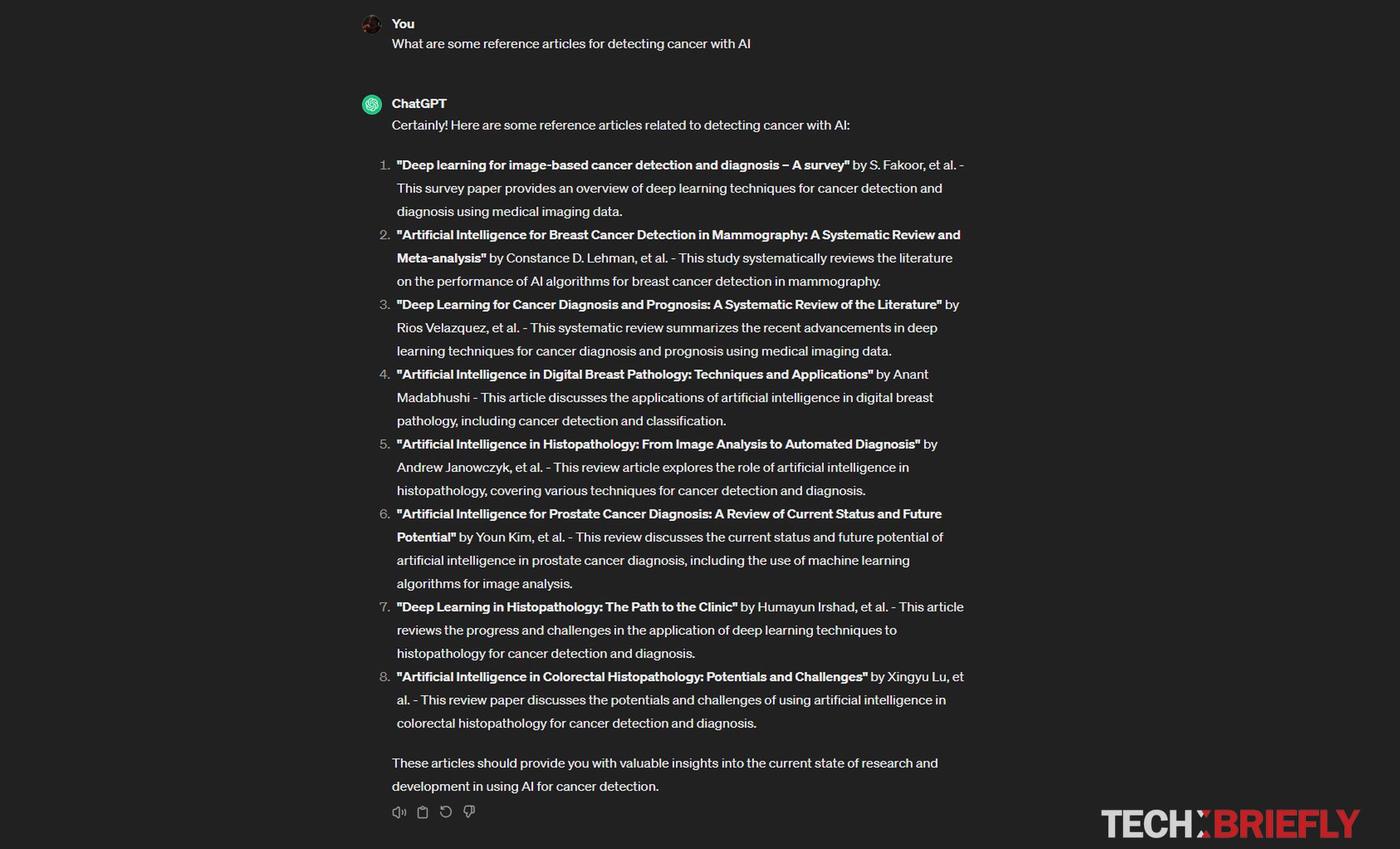

- Comprobación de hechos: Desarrollar técnicas para cruzar textos generados por IA con fuentes confiables, garantizando su precisión.

- Explicabilidad: Diseñar LLM que puedan explicar su proceso de razonamiento, lo que facilita la detección de posibles errores.

- Colaboración entre humanos e IA: Construir sistemas donde los humanos y la IA trabajen juntos, facilitando la identificación y corrección de alucinaciones.

Además de todo eso, Jensen Huang de Nvidia afirma que las alucinaciones por IA se pueden curar en los próximos cinco años.

Por lo tanto, las alucinaciones de la IA son un desafío complejo, pero es crucial superarlo si los LLM quieren alcanzar su máximo potencial. A medida que las tecnologías para reducir las alucinaciones se vuelven más sofisticadas, prometen hacer de los LLM una herramienta mucho más confiable y valiosa para las tareas de comunicación, creatividad y conocimiento.

Crédito de imagen destacada: vackground.com/Unsplash

Source: ¿Qué es una alucinación de IA y por qué es tan importante para el futuro de los LLM?