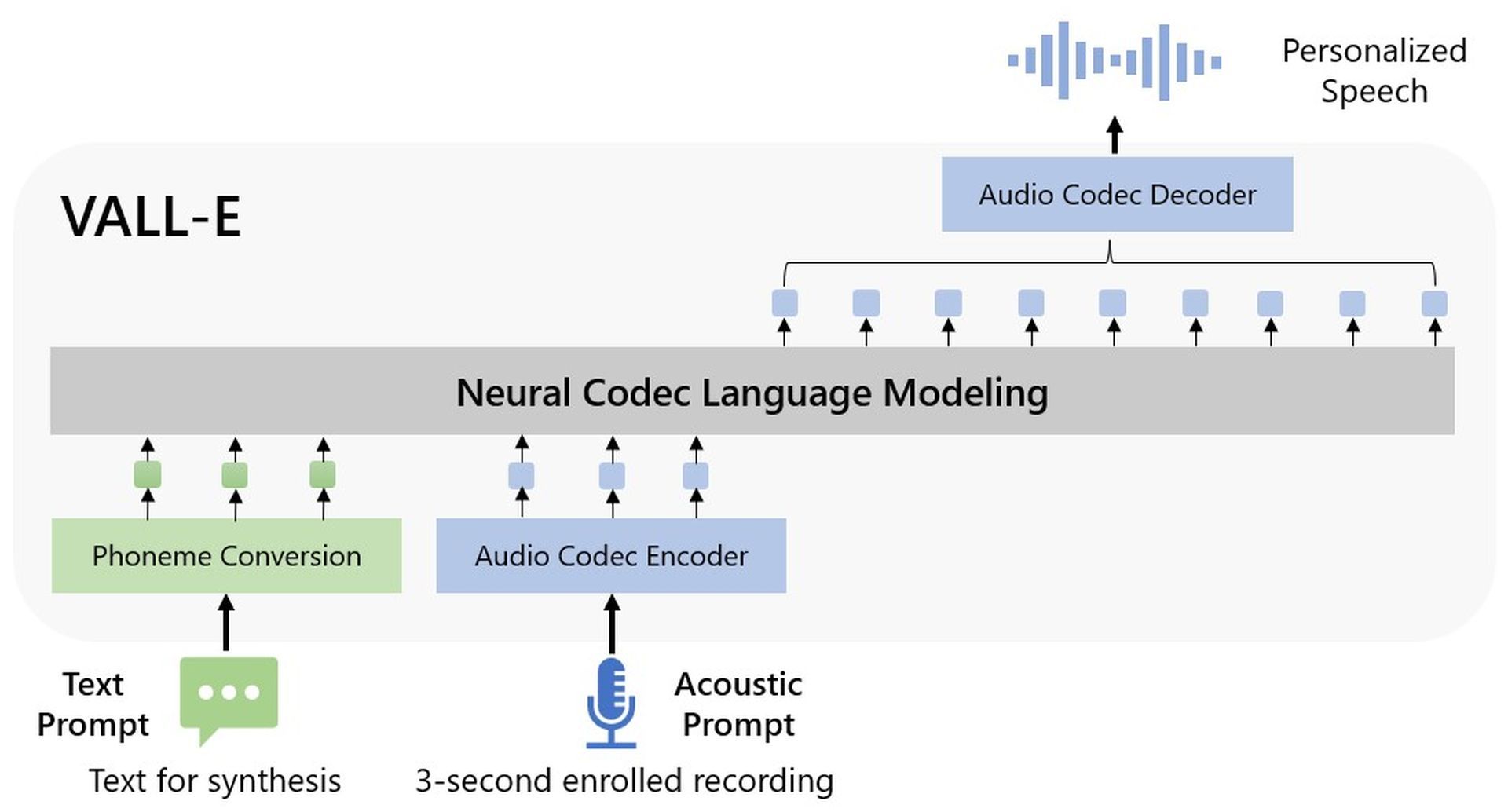

La versión de Microsoft de la síntesis de texto a voz, Microsoft VALL-E, se ha anunciado en un artículo publicado por la empresa. El modelo de audio solo requiere un archivo de audio de 3 segundos para procesar la entrada dada.

Microsoft acaba de lanzar Microsoft VALL-E, un enfoque de modelo de lenguaje novedoso para la síntesis de texto a voz (TTS) que aprovecha los códigos de códec de audio como representaciones intermedias. Fue entrenado previamente en 60,000 horas de datos de habla en inglés y luego mostró habilidades de aprendizaje en contexto en circunstancias de cero intentos.

Microsoft VALL-E puede producir un discurso personalizado de alta calidad con solo una grabación registrada de tres segundos de un hablante oblicuo que actúa como un estímulo acústico. Lo hace sin necesidad de ingeniería estructural adicional, características acústicas prediseñadas o ajustes finos. Es compatible con el aprendizaje contextual y los enfoques de TTS de disparo cero basados en indicaciones. Parece que la ampliación de los datos semisupervisados para TTS se ha infrautilizado porque Microsoft ha utilizado una cantidad significativa de datos semisupervisados para construir un sistema TTS generalizado en la dimensión del hablante.

¿Qué puedes hacer con Microsoft VALL-E?

Según los investigadores, Microsoft VALL-E es un “modelo de lenguaje de códec neuronal” que se entrenó con códigos discretos que “derivaron de un modelo de códec de audio neuronal preexistente”. Fue entrenado en 60 mil horas de habla, que es “cientos de veces mayor que los sistemas existentes”, según el comunicado. Estos ejemplos son convincentes en contraste con los intentos anteriores que obviamente son robots, a pesar de que la IA ha existido durante un tiempo y puede imitar de manera realista el habla humana.

Microsoft VALL-E puede “preservar la emoción y el entorno auditivo del orador”, según los investigadores, del aviso. Aunque es impresionante, la tecnología todavía está muy lejos de reemplazar a los actores de doblaje porque encontrar el tono y la emoción adecuados durante una actuación es diferente. Incluso una versión avanzada de Microsoft VALL-E no podría funcionar tan bien como un profesional calificado, sin embargo, las empresas a menudo priorizan la rentabilidad sobre la calidad.

En la demostración de GitHub de Microsoft, puede escuchar algunas de las muestras.

Características de Microsoft VALL-E

Aunque Microsoft VALL-E es muy nuevo, ya tiene muchas funciones.

Síntesis de la diversidad: Debido a que Microsoft VALL-E genera tokens discretos utilizando la técnica basada en muestreo, su salida varía para el mismo texto de entrada. Por lo tanto, puede sintetizar diferentes muestras de voz personalizadas utilizando una variedad de semillas aleatorias.

Mantenimiento del ambiente acústico: Microsoft VALL-E puede proporcionar un discurso personalizado mientras mantiene el entorno acústico del aviso del orador. En comparación con la línea de base, VALL-E está entrenado en un gran conjunto de datos con más variables acústicas. El audio y las transcripciones se produjeron utilizando muestras del conjunto de datos de Fisher.

Mantenimiento de la emoción del hablante: Usando la base de datos de voces emocionales como un recurso para, por ejemplo, indicaciones de audio, Microsoft VALL-E puede crear un discurso personalizado mientras mantiene el tenor emocional de la indicación del hablante. Los enfoques tradicionales entrenan un modelo al correlacionar el discurso con la transcripción y una etiqueta de emoción en un conjunto de datos de TTS emocional supervisado. VALL-E puede mantener la emoción en el aviso incluso en una situación de tiro cero.

Microsoft VALL-E todavía tiene problemas con la estructura del modelo, la cobertura de datos y la solidez de la síntesis.

¿Cómo funciona Microsoft WALL-E?

Microsoft usó LibriLight, una biblioteca de audio creada por Meta, para entrenar las habilidades de síntesis de VALL-voice E. La mayoría de las 60 000 horas de habla en inglés provienen de audiolibros de dominio público de LibriVox y las hablan más de 7000 personas diferentes. La voz en la muestra de tres segundos debe parecerse mucho a una voz en los datos de entrenamiento para que VALL-E obtenga un resultado satisfactorio.

Microsoft ofrece docenas de ejemplos de audio del modelo de IA en acción en la página de ejemplos de VALL-E. El “Aviso del altavoz”, una de las muestras, son los tres segundos de audio que VALL-E debe imitar. La “Verdad básica” es un extracto previamente grabado de ese altavoz que se usa como punto de referencia (algo así como el “control” en el experimento). La muestra “VALL-E” es el resultado del modelo VALL-E, y la muestra “Baseline” es un ejemplo de síntesis producida por un enfoque tradicional de síntesis de texto a voz.

Si bien Microsoft VALL-E hizo historia como el primer gran proyecto de IA de 2023, pero ciertamente no el último, el gigante tecnológico apoyó financieramente a OpenAI Point-E, que se publicó en las últimas semanas de 2022.