Los modelos de difusión estable son un tipo de modelo generativo que se puede utilizar para crear imágenes, texto e incluso música realistas. Trabajan comenzando con una imagen o texto con ruido aleatorio y luego agregándole detalles gradualmente, guiados por un proceso de difusión. Este proceso garantiza que el modelo no cree imágenes poco realistas o inestables.

Los modelos de difusión estable funcionan creando primero una imagen de ruido aleatorio. Luego, utilizan un proceso de difusión para ir perfeccionando la imagen, teniendo en cuenta la descripción del texto.

El proceso de difusión comienza con una descripción de alto nivel de la imagen, como “un gato sentado en un sofá”. A medida que avanza el proceso, la descripción se vuelve más detallada, como por ejemplo “un gato atigrado sentado en un sofá azul frente a una chimenea”.

¿Cuáles son los mejores modelos de Difusión Estable?

Se ha demostrado que los modelos de difusión estable pueden generar imágenes de alta calidad de una variedad de objetos y escenas. También se han utilizado para crear imágenes que son indistinguibles de fotografías reales.

La selección de los mejores modelos de difusión estable depende en realidad de sus necesidades. Cada modelo de Stable Diffusion está especializado para un estilo de generación único y todo depende de la imagen que se generará.

Difusión Waifu

Desde su lanzamiento, Waifu Diffusion se ha convertido en una conocida adaptación del anime Stable Diffusion. Si continúa entrenando el modelo en un conjunto de datos más pequeño que despierte su interés, puede ajustar uno que haya sido entrenado en un conjunto de datos enorme. Waifu Diffusion v1.4, la versión más reciente, es una actualización de Stable Diffusion v2 y utiliza 5.468.025 muestras de imágenes de texto del conocido tablero de imágenes de anime Danbooru.

Visión realista

El realismo es uno de los aspectos más desafiantes al enseñar a las máquinas a crear imágenes. Es difícil para las computadoras crear imágenes genuinamente realistas debido a nuestra capacidad de detectar incluso las imperfecciones y sutilezas más pequeñas. Sin embargo, los resultados proporcionados por el modelo entrenado de Realistic Vision son sobresalientes.

El “fondo blanco” fue la única área de dificultad para la modelo, quien fue capaz de producir una imagen realista de una mujer que estuvo muy cerca de cumplir con nuestro desafío. Por otro lado, la vista es impresionante y capta bien la belleza del entorno. El gráfico final demuestra la atención de Realistic Vision a los detalles minuciosos en el arte digital.

DreamShaper

DreamShaper se parece más a la ilustración debido a su maravilloso estilo de arte digital. Este modelo hizo un trabajo fantástico en el retrato, creando una pieza preciosa que captura perfectamente la personalidad y las cualidades estéticas de la persona retratada. En el campo, DreamShaper pudo crear obras de arte hermosas y vibrantes con detalles intrigantes. La imagen tiene una variedad de formas geométricas que le dan profundidad y dimensión, además de colores llamativos.

Este modelo es lo que necesita si desea que sus modelos de Difusión Estable puedan producir gráficos. Además, puede cambiar algunas configuraciones para que los productos terminados parezcan obras de arte digitales.

cualquier modelo

El modelo Anything se desarrolló principalmente para reproducir escenas de estilo anime. Esto es particularmente evidente en el caso de nuestro desafío de retrato, que dio lugar a un joven protagonista con una variedad de opciones de diseño sutiles. Cualquier cosa, a pesar de su aspecto cómico, creaba un entorno maravilloso con tonos suaves. El ejemplo también ilustró la capacidad de Anything para crear estructuras y componentes intrincados.

Cualquier tema puede servir como base para una obra de arte de estilo anime. Recomendamos encarecidamente probar VAE para aprovechar al máximo este fantástico modelo de Difusión Estable.

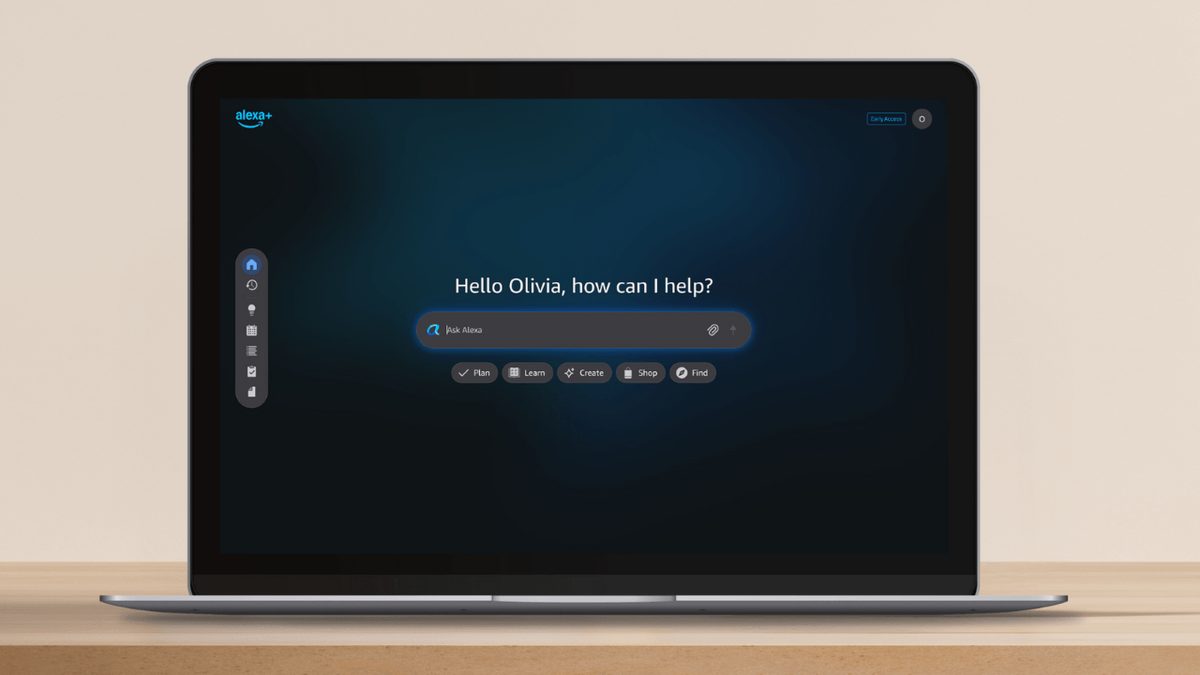

Cómo instalar modelos de Difusión Estable

Para utilizar modelos de difusión estables, primero debe adquirir las herramientas necesarias o, para ser precisos, la interfaz de usuario web de Automatic111 SD. Para instalar Automatic111, necesitará:

- Python 3.10.6 o superior

- git

Una vez que los tenga, puede seguir estos pasos para instalar Automatic111:

- Clonar el repositorio Automatic111

- Abra una ventana de terminal y navegue hasta el directorio donde desea instalar Automatic111. Luego, ejecute el siguiente comando: git clone https://github.com/AUTOMATIC111/web-ui.git

- Ejecute Automático111. En la ventana de la terminal, navegue hasta el directorio donde clonó el repositorio Automatic111

- Luego, ejecute el siguiente comando: python webui.py

Esto iniciará la interfaz web de Automatic111. Puede utilizar la interfaz web para crear imágenes y texto con el modelo de difusión estable.

Una vez que haya hecho eso, todo lo que tiene que hacer es visitar Civit.AI y descargar un modelo que le guste y dirigirse a la carpeta “Modelos” dentro del directorio de instalación de Stable Diffusion y pegar el modelo allí.

Para usar el modelo, debe abrir la interfaz de usuario web SD de Automatic111 y seleccionar el modelo en la esquina superior izquierda. Recuerde, cada modelo es bueno para generar un estilo único, por lo que probar diferentes modelos de Stable Diffusion para generaciones únicas es la clave del éxito en la creación de imágenes impresionantes con Stable Diffusion.

Una vez que haya elegido un modelo de nuestra lista de los mejores modelos de Difusión estable, asegúrese de aprender a utilizar ControlNet Difusión estable para generar mejores imágenes.

Crédito de la imagen destacada: chandlervid85/Freepik.