Microsoft ha lanzado un nuevo e interesante desarrollo en el campo de los modelos de lenguaje: el LLM de 1 bit. Este avance, inspirado en proyectos de investigación como BitNet, marca un cambio notable en la forma en que se construyen y optimizan los modelos de lenguaje. En el corazón de esta innovación se encuentra un método sorprendentemente eficiente para representar los parámetros (o pesos) del modelo.utilizando sólo 1,58 bits, a diferencia del tradicional punto flotante de 16 bits (FP16) enfoque predominante en los modelos anteriores.

El LLM de 1 bit, el primero de su tipo

Apodado BitNet LLM b1.58este enfoque pionero limita los valores potenciales de cada peso a solo tres opciones: -1, 0 o +1. Esta drástica reducción del número de bits necesarios por parámetro es lo que sienta las bases de esta tecnología innovadora. Sorprendentemente, a pesar de su reducido consumo de bits, BitNet b1.58 logra Ofrecer métricas de rendimiento comparables a las de los modelos tradicionales. Esto incluye áreas como la perplejidad y el rendimiento de la tarea final, todo ello utilizando el mismo tamaño y conjuntos de datos de entrenamiento.

¿Qué son los LLM de 1 bit?

La escena de la IA generativa evoluciona día a día, y el último avance en este campo dinámico es la llegada de los modelos de aprendizaje de idiomas de 1 bit. Puede parecer sorprendente, pero este desarrollo tiene el potencial de transformar el ámbito de la IA al abordar algunos de los obstáculos más importantes que enfrentan los LLM en la actualidad:es decir, su gigantesco tamaño.

Normalmente, los pesos de un modelo de aprendizaje automático, ya sea un LLM o algo tan sencillo como la regresión logística, se almacenan mediante Puntos flotantes de 32 o 16 bits. Este enfoque estándar es un arma de doble filo; Si bien permite una alta precisión en los cálculos del modelo, también da como resultado el inmenso tamaño de estos modelos.

Esta inflación es precisamente la razón por la que implementar campeones de peso pesado como GPT en sistemas locales o en entornos de producción se convierte en una pesadilla logística. Su número astronómico de pesos, requerido por la precisión de estos puntos flotantes, aumenta su tamaño a proporciones inmanejables.

En marcado contraste con los modelos tradicionales, Los LLM de 1 bit utilizan un solo bit (0 o 1) para representar los parámetros de peso. Este ajuste aparentemente menor tiene implicaciones importantes: reduce drásticamente el tamaño total de los modelos, potencialmente por un amplio margen.

Esta reducción de tamaño abre el camino para el despliegue de LLM en dispositivos mucho más pequeñoshaciendo que las aplicaciones avanzadas de IA sean más accesible y factible en una gama más amplia de plataformas.

Volver a BitNet LLM b1.58

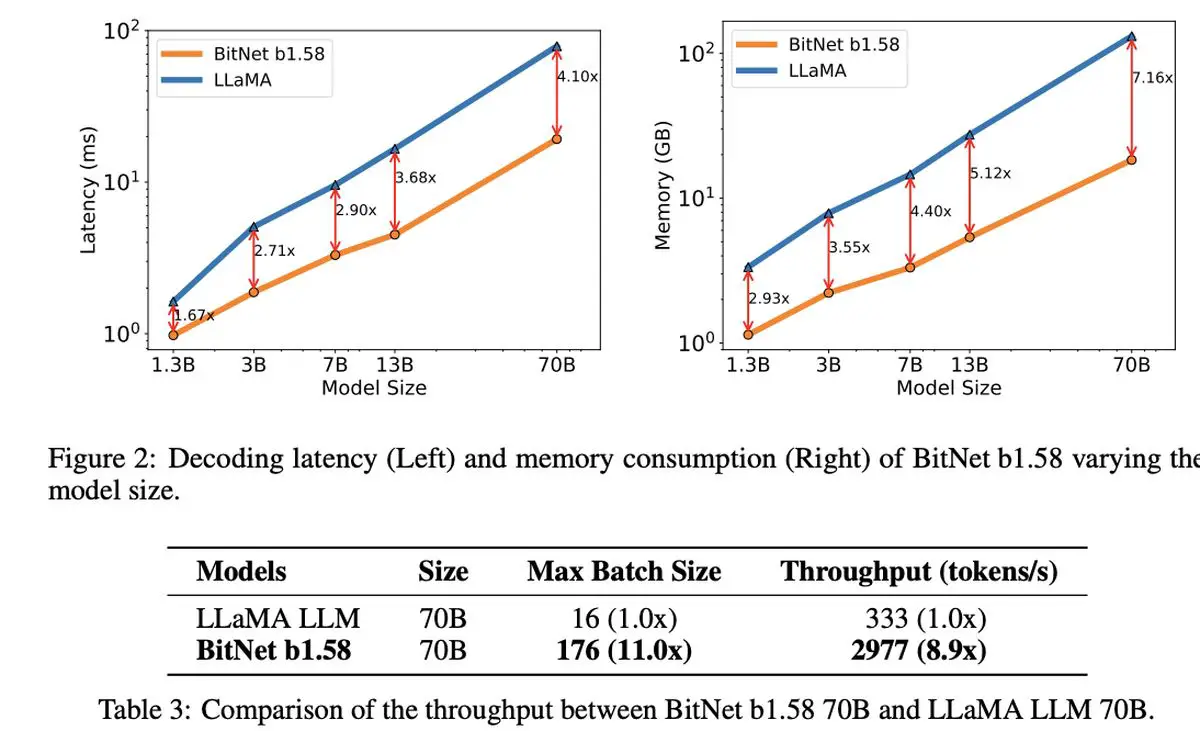

Lo realmente destacable del LLM de 1,58 bits es su rentabilidad. El modelo brilla en términos de latencia reducida, menor uso de memoria, rendimiento mejorado y menor consumo de energía, lo que presenta una opción sostenible en el mundo computacionalmente intensivo de la IA.

LLM de 1 bit de Microsoft no sólo destaca por su eficiencia. Representa una nueva perspectiva sobre la ampliación y la capacitación de modelos de lenguaje, equilibrando el rendimiento de primer nivel con la viabilidad económica. Insinúa el amanecer de nuevos paradigmas informáticos y la posibilidad de crear hardware especializado diseñado para ejecutar estos modelos más ágiles y eficientes.

También se abre la discusión en torno a BitNet LLM b1.58 Posibilidades intrigantes para gestionar secuencias largas de forma más eficaz en LLM.sugiriendo áreas potenciales para futuras investigaciones en técnicas de compresión sin pérdidas para aumentar aún más la eficiencia.

A la sombra de esta notable innovación, Microsoft también ha estado causando sensación con su último modelo de lenguaje pequeño, Phi-2. Esta potencia de 2.700 millones de parámetros ha demostrado capacidades excepcionales de comprensión y razonamiento, una prueba más del compromiso continuo de Microsoft para ampliar los límites de la tecnología de IA. La introducción del LLM de 1 bit, junto con el éxito de Phi-2, destacaría una era apasionante de innovación y eficiencia en el desarrollo de modelos de lenguaje.

Crédito de la imagen destacada: Drew Beamer/Unsplash