Los avances en tecnología continúan remodelando el panorama de la ciberseguridad, introduciendo nuevas oportunidades y riesgos imprevistos. Un equipo de investigadores provenientes de universidades británicas ha demostrado una hazaña alarmante que aprovecha las ondas de sonido para sustraer datos confidenciales de las pulsaciones de teclas del teclado. La técnica, que emplea un modelo de aprendizaje profundo, cuenta con una impresionante tasa de precisión del 95%.

El experimento se basó en el reconocimiento de que las ondas de sonido generadas por las pulsaciones del teclado podrían aprovecharse para discernir las pulsaciones de teclas reales. Los investigadores se embarcaron en un viaje pionero que mostró los peligros potenciales de los ataques acústicos a la seguridad de los datos.

La metodologia de la investigacion

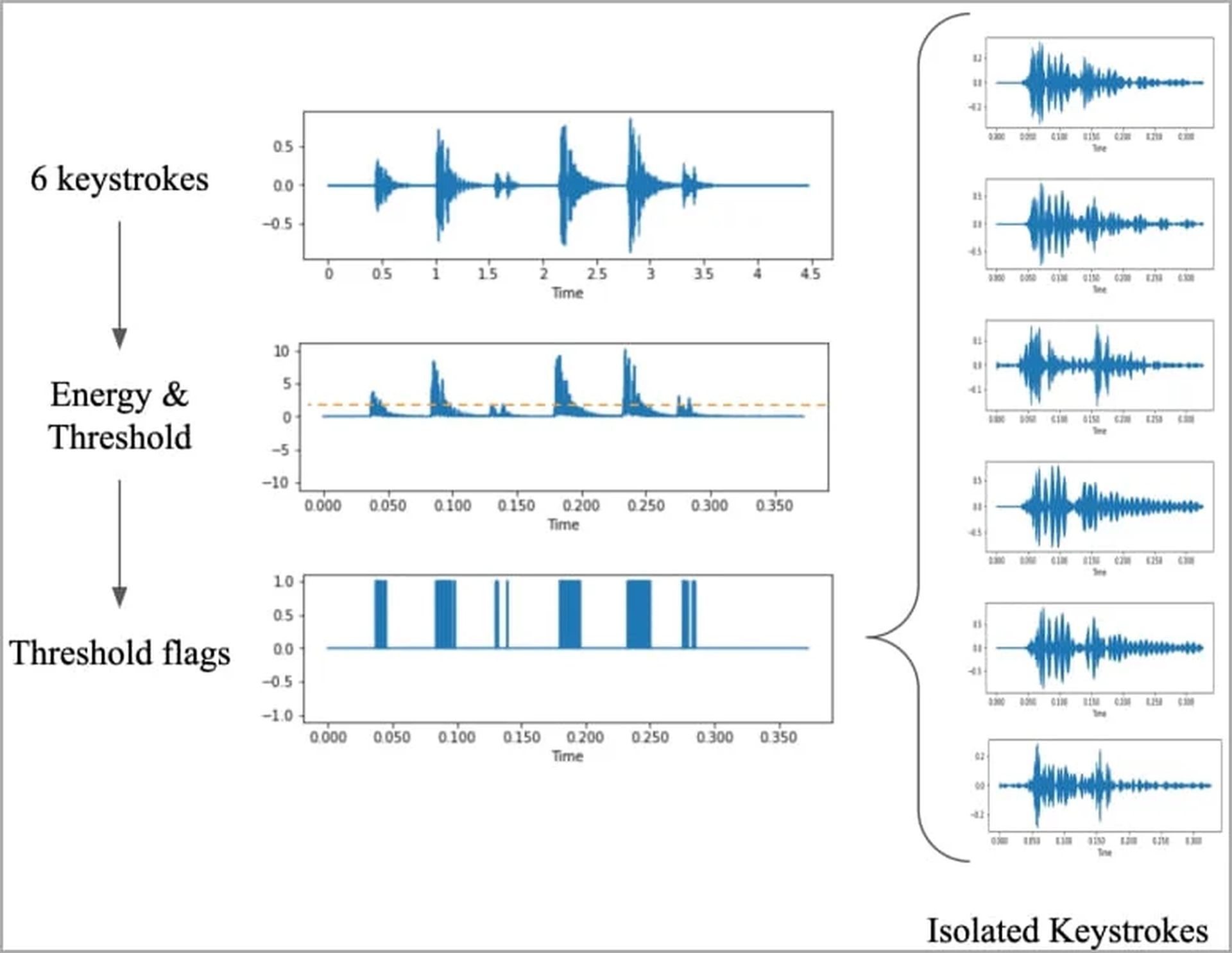

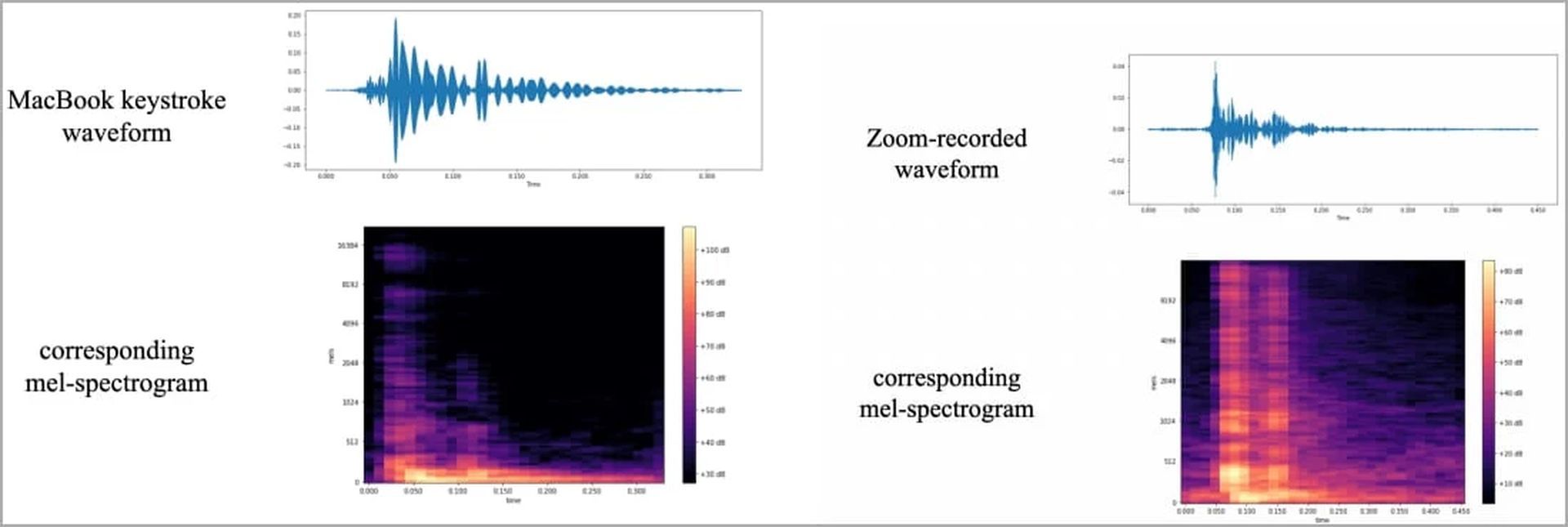

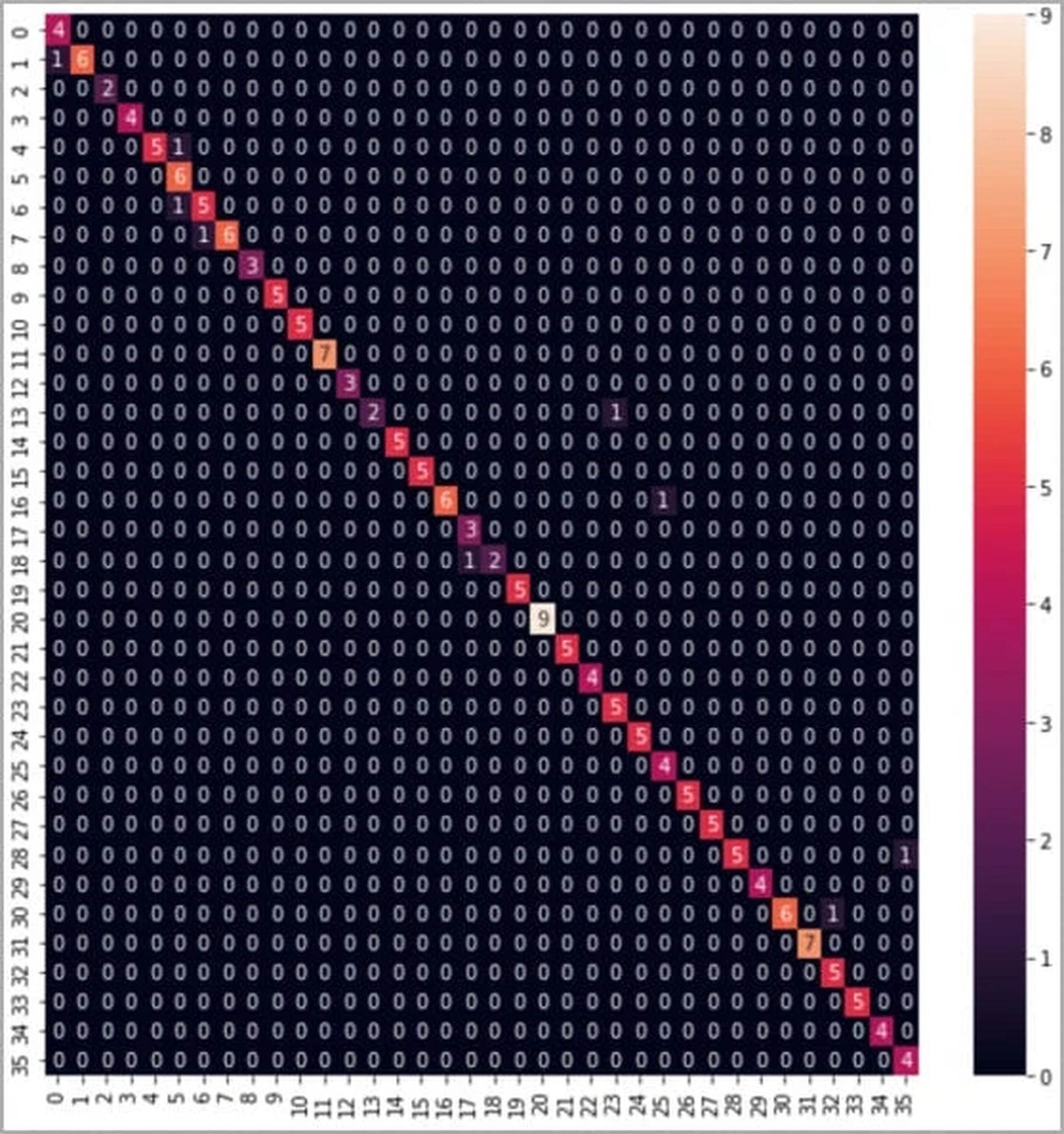

En el centro de esta hazaña audaz se encuentra el intrincado interacción entre el sonido, el aprendizaje automático y la extracción de datos. El equipo de investigación empleó una variedad de dispositivos, desde portátiles a teléfonos inteligentes, para capturar los perfiles de sonido únicos de las pulsaciones de teclas. Se presionaron un total de 36 teclas 25 veces cada una en una MacBook Pro moderna, mientras que las señales de audio resultantes se registraron meticulosamente.

Los datos de sonido capturados se sometieron una serie de pasos de procesamiento, eventualmente transformándose en representaciones visuales como formas de onda y espectrogramas. Estas visualizaciones mostraron variaciones distintivas para cada pulsación de tecla, allanando el camino para el desarrollo de un poderoso clasificador de imágenes, llamado ‘CoAtNet.’

Las implicaciones de los resultados

Las implicaciones de esta investigación son profundo y inquietante Ataques basados en acústica eludir las medidas de seguridad tradicionales, explotando el ubicuidad de los dispositivos equipados con micrófono obtener acceso no autorizado a información confidencial. Este enfoque novedoso es particularmente preocupante, ya que potencialmente puede exponer datos personales, incluidos contraseñas, conversaciones, mensajes, y otros datos confidenciales a los actores maliciosos.

Los ataques de canal lateral tradicionales generalmente requieren condiciones específicas y, a menudo, están sujetos a restricciones de distancia y velocidad de datos. Sin embargo, los ataques acústicos han dado paso a una nueva era de sencillez y eficiencia, aprovechando la abundancia de dispositivos capaces de grabar audio de alta calidad.

Estrategias de mitigación

Dado que esta innovadora investigación subraya la importancia crítica de la protección contra los ataques acústicos, se vuelve esencial explorar las estrategias de mitigación que los usuarios pueden emplear para proteger sus datos.

- Estilos de escritura alterados: El estudio recomienda a los usuarios que consideren alterar sus estilos de escritura para ofuscar la firma acústica de sus pulsaciones de teclas.

- Contraseñas aleatorias: El uso de contraseñas aleatorias puede interrumpir las capacidades de reconocimiento de patrones de los atacantes acústicos.

- Defensas basadas en software: El uso de software que imite los sonidos de las pulsaciones de teclas, la generación de ruido blanco o la utilización de filtros de audio basados en software pueden frustrar potencialmente el robo de datos.

- Autenticación biométrica: La implementación de métodos de autenticación biométrica puede mejorar la seguridad al agregar una capa adicional de verificación de identidad.

- Administradores de contraseñas: Confiar en los administradores de contraseñas puede minimizar la necesidad de ingresar manualmente información confidencial, lo que reduce la exposición a ataques acústicos.

En un mundo caracterizado por la rápida evolución de la tecnología, las preocupaciones de seguridad continúan evolucionando también. La investigación sirve como un claro recordatorio de que Constantemente surgen métodos innovadores de robo de datos, lo que requiere un enfoque proactivo y adaptable a la ciberseguridad. A medida que avanza el ámbito digital, también deben hacerlo nuestras defensas contra aquellos que buscan explotar sus vulnerabilidades.

Además de la investigación de las universidades británicas, ha habido un desarrollo creciente de modelos de IA que se centran en el robo de datos y las prácticas de piratería. El mes pasado, surgió un modelo de IA centrado en el robo de datos con el nombre FraudGPT, así como un modelo de IA llamado WormgGPT, que afirma no tener límites, lo que permite conversaciones ilegales y poco éticas.

Si desea estar más preparado con respecto a los desarrollos en curso en el aprendizaje profundo y los modelos de IA, asegúrese de consultar nuestro artículo sobre cómo tener cuidado con las estafas generalizadas de ChatGPT.

Crédito de la imagen destacada: Sergi Cabrera / Unsplash