La inteligencia artificial (IA) ha fascinado a algunas personas y ha sido criticada por otras desde hace mucho tiempo. Se ha vuelto difícil predecir qué es posible y qué no con la IA. Un grupo de académicos de la Universidad de Columbia Británica (UBC) en Vancouver ha ideado algo que puede parecer ciencia ficción: un científico de IA totalmente autónomo. Esta IA analiza datos y crea y ejecuta experimentos. Este descubrimiento tiene implicaciones fascinantes y, para algunos, inquietantes.

Aunque la idea de un científico de IA puede parecer un sueño descabellado, el equipo de la UBC lo ha hecho realidad a través de asociaciones con la Universidad de Oxford y Sakana AI. Si bien estos documentos de trabajo generados por IA pueden no contribuir mucho a la ciencia en un principio, el hecho de que sean el resultado del aprendizaje automático de sus experimentos y que funcionen representa un avance en la investigación de la IA.

El científico de IA que nunca deja de aprender

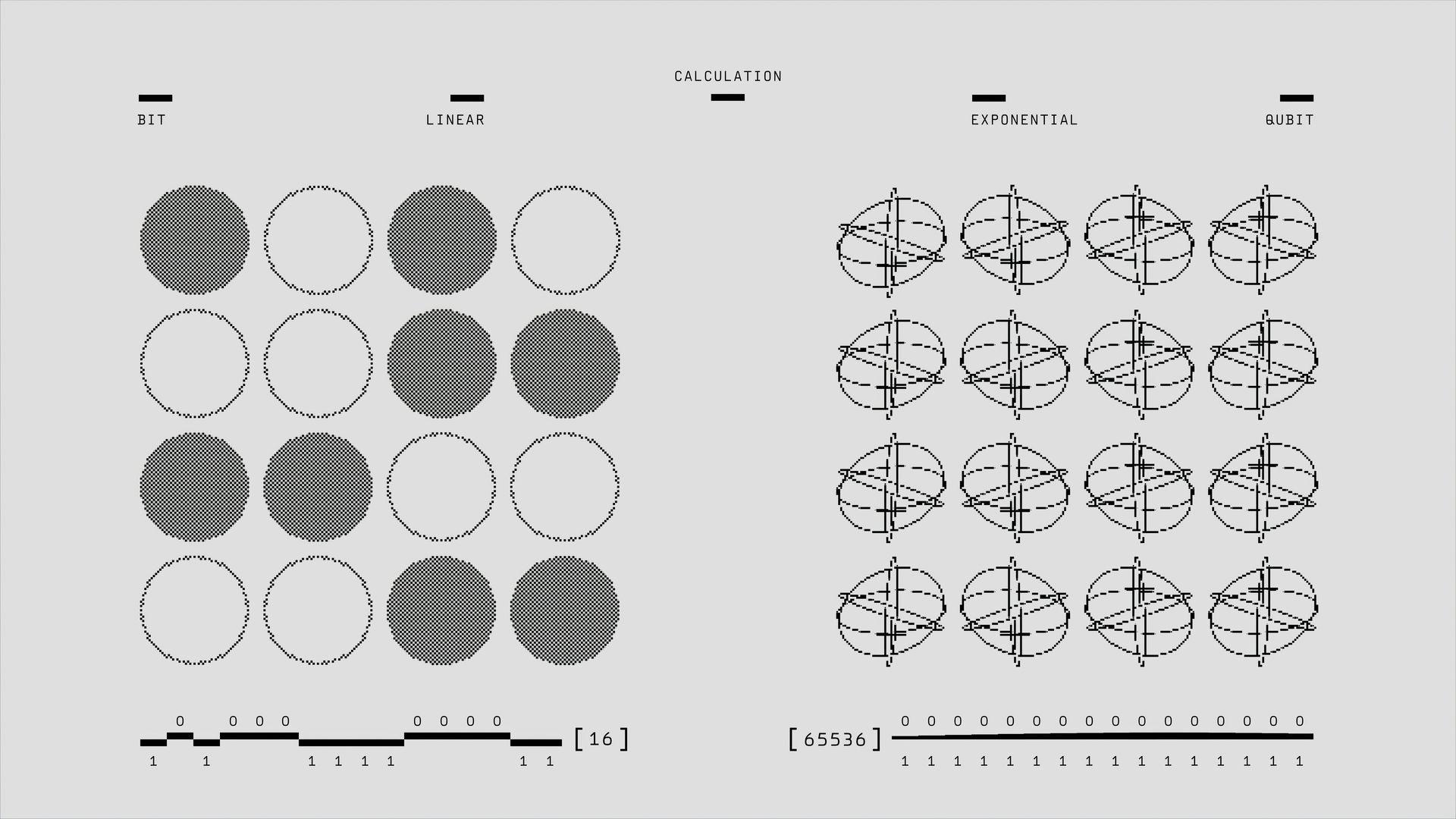

Este trabajo se centra en un enfoque denominado aprendizaje abierto. Este nuevo científico de la IA funciona de manera diferente a la IA tradicional, que depende de grandes cantidades de datos creados por humanos. Aprende probando cosas nuevas, investigándolas y perfeccionándolas. Con esta técnica, la IA puede ampliar los límites del conocimiento actual y tal vez encontrar nuevos conocimientos que los investigadores humanos podrían haber pasado por alto.

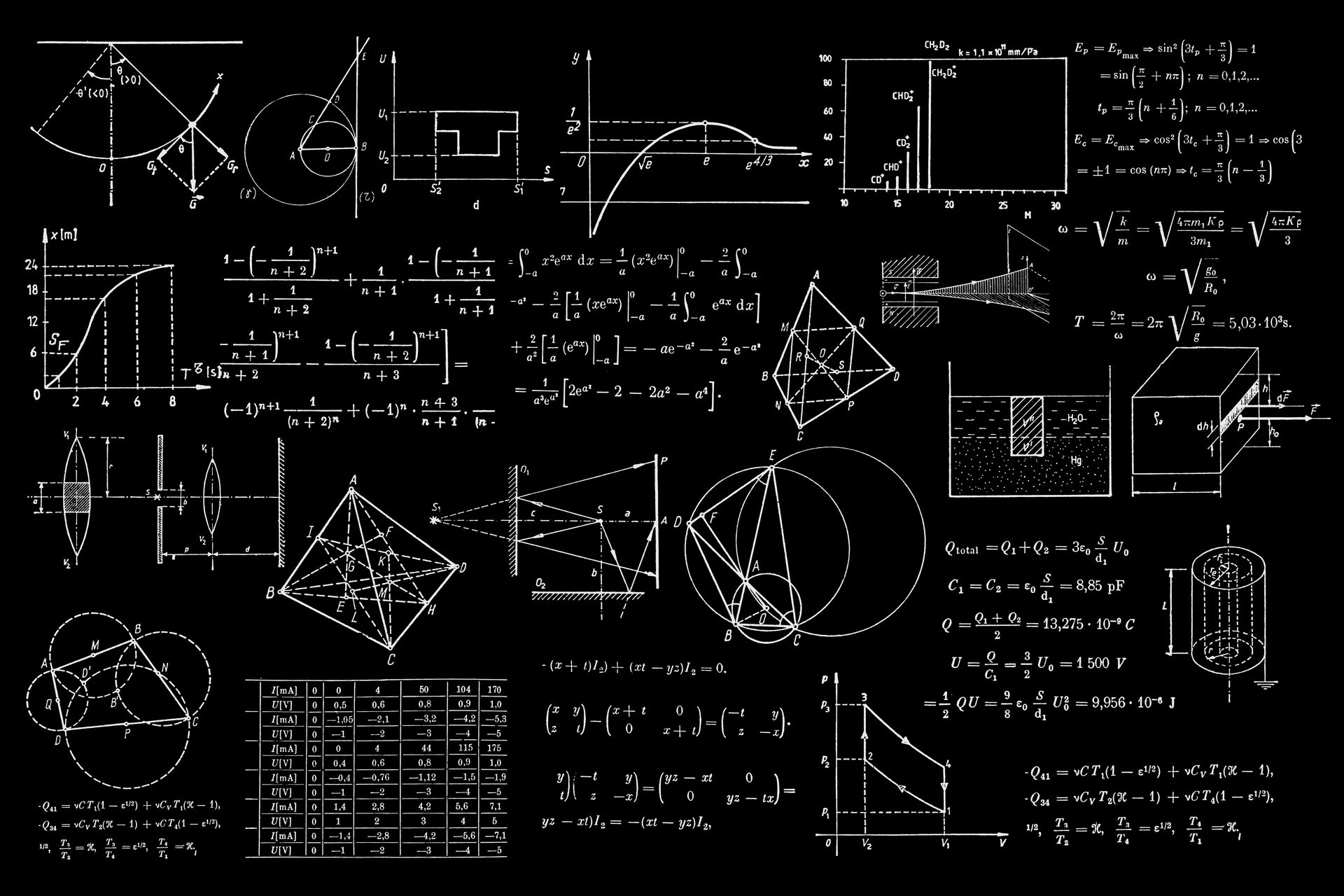

Una de las primeras tareas que abordó este científico de IA fue mejorar las técnicas de aprendizaje automático existentes, como el modelado de difusión y la aceleración de redes neuronales profundas. Si bien estos pueden no parecer avances revolucionarios, representan la capacidad de la IA para desarrollar y probar ideas de manera autónoma. La IA por sí sola no podía hacer muchas cosas cuando apareció por primera vez, pero ahora ha comenzado a ingresar en todos los aspectos de nuestras vidas.

Jeff Clune, el profesor que dirige el laboratorio de la UBC, reconoció que los resultados no son necesariamente un éxito, pero son prometedores. El enfoque del científico de IA para el aprendizaje (refinando constantemente sus experimentos y buscando cosas que le parezcan “interesantes”) es un nuevo cambio con respecto a los métodos más rígidos que se utilizan tradicionalmente en la investigación de IA.

Los científicos de IA prueban y perfeccionan sus teorías de forma independiente

El laboratorio de Clune ha estado experimentando con el aprendizaje abierto durante un tiempo. En proyectos anteriores, desarrollaron programas de IA diseñados para explorar entornos virtuales y generar comportamientos basados en lo que les resulta interesante. Estos programas debían guiarse cuidadosamente con instrucciones codificadas a mano, pero la introducción de grandes modelos de lenguaje (LLM) ha cambiado las reglas del juego. Ahora, estos programas de IA pueden determinar de forma independiente qué vale la pena investigar, lo que los hace más autónomos y potencialmente más creativos.

La capacidad de los científicos de IA para escribir el código necesario para validar sus teorías, así como para ejecutar pruebas, es uno de sus atributos más fascinantes. Esto permite a la IA refinar continuamente su estrategia, volviéndose cada vez más eficaz y quizás más perceptiva. Clune compara este proceso con el descubrimiento de un nuevo continente porque ambos implican el espíritu de exploración y lo desconocido y la posibilidad de grandes sorpresas en el camino.

La fiabilidad de estos sistemas es escasa, a pesar de su brillante futuro. Aunque los científicos especializados en IA pueden parecer extraordinarios, Tom Hope, investigador del Instituto Allen de IA, afirma que todavía son muy poco fiables y poco originales. Esta desconfianza se debe al hecho de que la IA promete demasiado y cumple poco, especialmente en las áreas de creatividad e innovación auténtica.

Gestión del potencial y el riesgo

Con la creación de la IA científica, también han surgido preocupaciones sobre el rumbo de la investigación científica. Cuando la IA pueda crear y evaluar teorías por sí sola, ¿dónde estarán los investigadores humanos? Además, ¿cómo podemos garantizar que estas tecnologías de IA se utilicen de forma adecuada? ¿Podría una persona malintencionada entrenar a un científico de IA en casa y utilizarlo con fines maliciosos en el futuro?

Este científico de IA ya está haciendo avances en la creación de agentes de IA, que son programas autónomos con funciones predeterminadas. El grupo de Clune ha creado agentes diseñados por IA que superan a sus homólogos diseñados por humanos en habilidades como las matemáticas y la comprensión lectora. Este éxito sugiere un futuro en el que la IA podría contribuir a la innovación en formas que aún no están claras, en lugar de simplemente ayudar con las actividades cotidianas.

Pero este avance conlleva ciertos riesgos. Es bastante preocupante que estos sistemas de IA puedan producir agentes que se comporten mal, ya sea de forma intencionada o no. Clune y su grupo son conscientes de los riesgos y están intentando encontrar soluciones para evitar que se produzcan este tipo de situaciones. Sostienen que el secreto es supervisar adecuadamente la creación de estos sistemas para garantizar su solidez y seguridad.

Aunque no está claro a dónde nos llevará todo esto, una cosa es segura: los científicos de IA están aquí y no van a dejar de ser cada vez más inteligentes. La IA está a punto de entrar en una nueva fase y todos la estarán observando de cerca para ver si conduce a descubrimientos innovadores o a nuevos problemas. A medida que la IA evolucione, será vital que los académicos enfaticen las cuestiones éticas y se aseguren de que estos sistemas se construyan de manera ética. En última instancia, la forma en que abordemos la compleja relación entre la tecnología y los humanos determinará el impacto de la IA en la sociedad.

Crédito de la imagen destacada: Instituto Nacional del Cáncer / Unsplash

Source: Los científicos de IA investigan, aprenden y descubren