El Mistral Large 2 ya está aquí y aporta un nuevo nivel de sofisticación a los modelos de lenguaje. Con sus 123 mil millones de parámetros y una impresionante ventana de contexto de 128 000 tokens, este modelo puede abordar textos extensos y conversaciones complejas con facilidad. Está diseñado para ser preciso, reducir los errores en la información y, al mismo tiempo, destacarse en tareas de codificación y multilingües.

Descubra cómo las capacidades avanzadas de Mistral Large 2 están ampliando los límites de lo que la IA puede hacer, desde resolver problemas matemáticos hasta admitir una amplia gama de lenguajes de programación.

Mistral Large 2: una visión general completa

Mistral Large 2 se destaca como un avance significativo en el campo de los modelos de lenguaje, combinando una escala sustancial con tecnología de vanguardia, y aquí explicamos por qué.

Ventana de contexto y escala del modelo

Mistral Large 2 se distingue por sus 123 mil millones de parámetros. Los parámetros son los componentes principales de un modelo de lenguaje, lo que le permite aprender y generar texto basado en patrones encontrados en sus datos de entrenamiento. La gran cantidad de parámetros permite a Mistral Large 2 comprender y generar texto más complejo y matizado.

El modelo también cuenta con una amplia ventana de contexto con capacidad para 128.000 tokens. Esta gran ventana de contexto significa que Mistral Large 2 puede procesar y generar texto manteniendo la coherencia en pasajes muy largos, lo que lo hace eficaz para manejar documentos extensos y conversaciones detalladas.

Uno de los principales desafíos de los modelos lingüísticos es la generación de información que parece plausible pero que es incorrecta, conocida como alucinaciones. Mistral Large 2 ha sido entrenado específicamente para reducir este problema. Está diseñado para reconocer cuando no tiene suficiente información, en lugar de generar contenido potencialmente engañoso. Esta mejora aumenta la precisión y la fiabilidad del modelo.

Rendimiento en los puntos de referencia

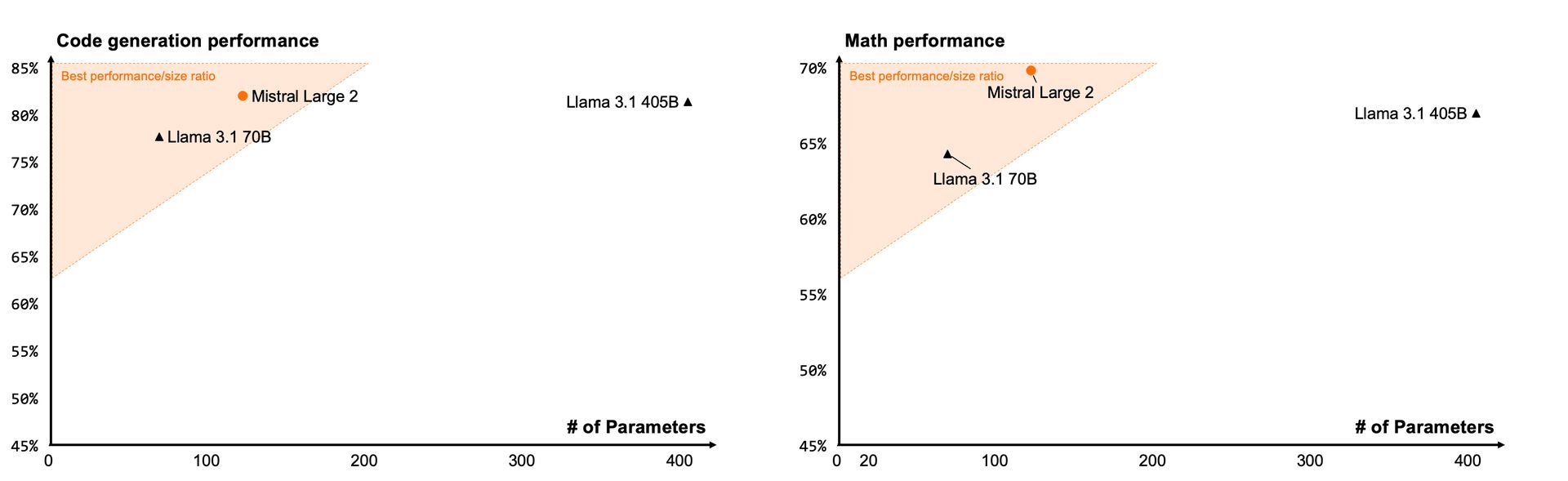

Mistral Large 2 ha demostrado un sólido rendimiento en varios puntos de referencia:

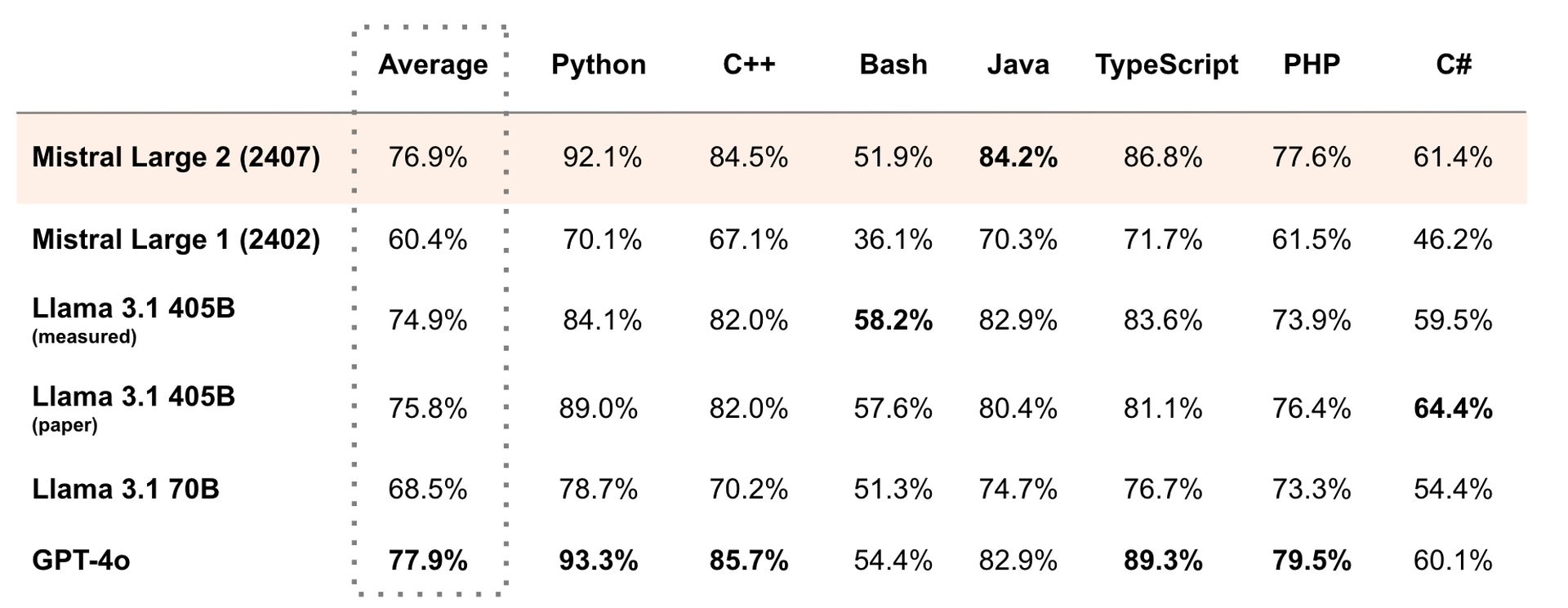

- Tareas de codificación:En el benchmark HumanEval, que pone a prueba las habilidades de programación, Mistral Large 2 muestra un alto nivel de competencia y un rendimiento comparable al de modelos líderes como GPT-4. Esto indica su capacidad para comprender y generar código de manera eficaz.

- Resolución de problemas matemáticos:El modelo tiene un buen desempeño en el parámetro MATH, que evalúa las capacidades de resolución de problemas matemáticos. Aunque se ubica justo detrás de GPT-4, su desempeño refleja su capacidad para manejar cálculos complejos y tareas lógicas.

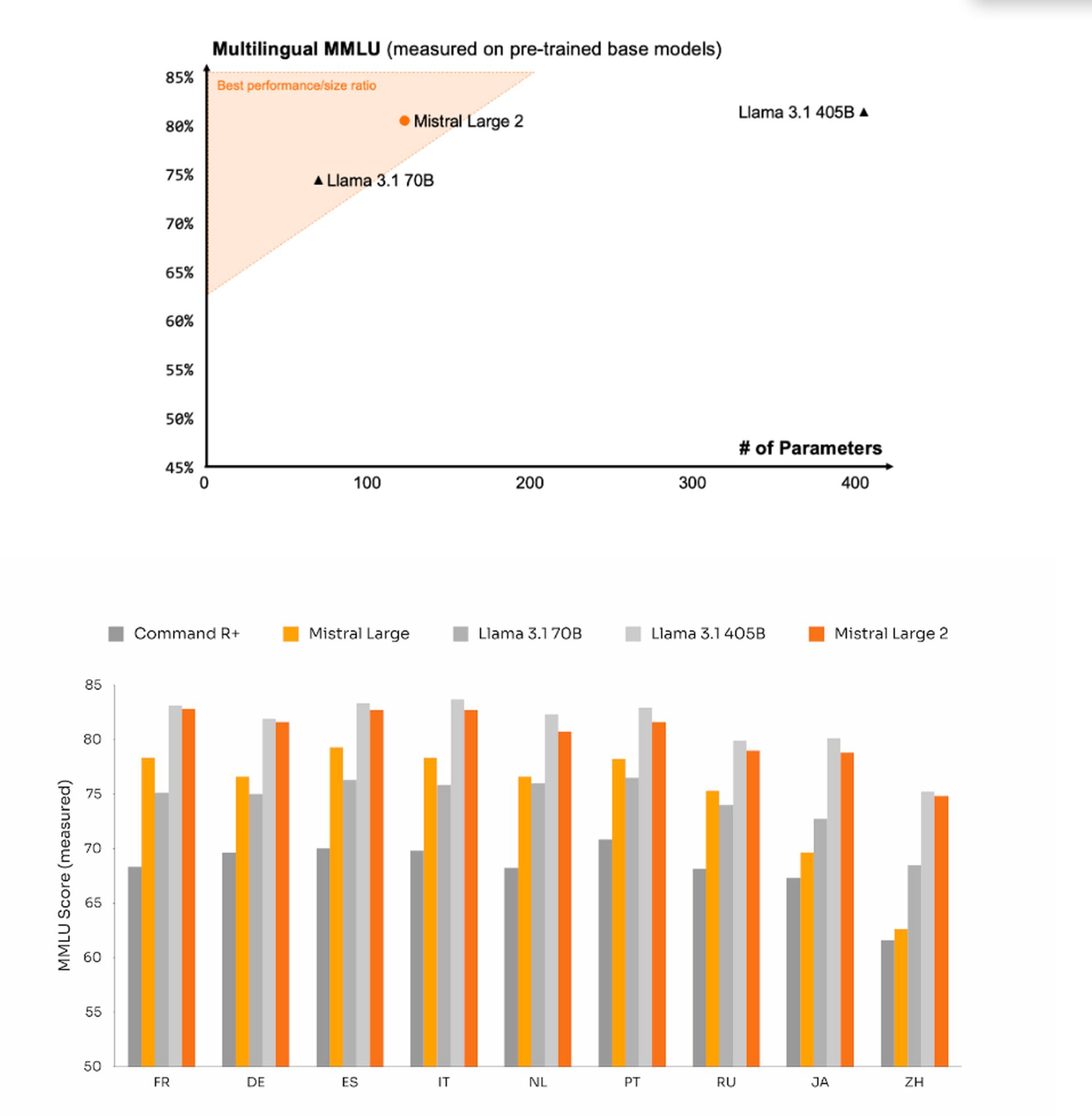

- Rendimiento multilingüe:En la prueba multilingüe MMLU, Mistral Large 2 destaca en varios idiomas, demostrando su capacidad para procesar y generar texto en diversos contextos lingüísticos.

Especificaciones técnicas

Mistral Large 2 está diseñado para funcionar de manera eficiente a pesar de su gran escala. Puede ejecutarse en una sola máquina, lo cual es significativo dado su tamaño. Esta eficiencia es beneficiosa para aplicaciones que requieren procesar grandes cantidades de texto rápidamente.

Capacidades de codificación

El modelo admite más de 80 lenguajes de programación, incluidos los más populares, como Python, Java, C, C++, JavaScript y Bash. Este amplio soporte es el resultado de una amplia capacitación centrada en las tareas de programación, lo que convierte a Mistral Large 2 en una herramienta versátil para desarrolladores y quienes trabajan con código.

Capacidades multilingües

Mistral Large 2 es capaz de procesar y generar texto en numerosos idiomas, incluidos:

- Idiomas europeos: francés, alemán, español, italiano, portugués

- Idiomas asiáticos: árabe, hindi, ruso, chino, japonés, coreano

Este amplio soporte de idiomas permite que el modelo gestione diversas tareas y aplicaciones multilingües.

La parte que falta

Actualmente, Mistral Large 2 no ofrece capacidades multimodales, que implican procesar texto e imágenes simultáneamente. Este es un área en la que otros modelos, como los de OpenAI, tienen actualmente una ventaja. Los desarrollos futuros pueden abordar esta brecha.

Cómo utilizar Mistral Large 2

Mistral Large 2 está disponible a través de varias plataformas, incluidas:

- Inteligencia artificial de Google Vertex

- La roca madre del Amazonas

- Estudio de inteligencia artificial de Azure

- IBM WatsonX.AI

Para la experimentación, Mistral también ofrece acceso a través de su competidor de ChatGPT, le Chat. Sin embargo, si bien el modelo es más accesible que el de algunos competidores, no es de código abierto y su uso comercial requiere una licencia paga.

Entonces, ¿es el nuevo modelo Large 2 de Mistral lo suficientemente grande?

El modelo Large 2 de Mistral es de hecho bastante grande, con 123 mil millones de parámetros, lo que lo convierte en uno de los modelos de lenguaje más extensos disponibles. Esta escala le permite manejar tareas complejas de generación de texto y mantener la coherencia en pasajes largos. Su ventana de contexto de 128.000 tokens mejora aún más su capacidad para procesar y generar documentos detallados y extensos.

Además de su gran tamaño, Mistral Large 2 ha sido optimizado para minimizar problemas como la generación de información incorrecta, mejorando su confiabilidad. También tiene un buen desempeño en varios puntos de referencia, incluidos la codificación y la resolución de problemas matemáticos, y es compatible con varios idiomas. Entonces, sí, Mistral Large 2 es impresionantemente grande y capaz, y satisface las necesidades de muchas aplicaciones de IA avanzadas.

Source: ¿Es el nuevo modelo Large 2 de Mistral lo suficientemente grande?